Maistudio es un estudio dedicado a la producción de audio y a la investigación+diseño de herramientas para la producción e interpretación musical. Esta sección es una especie de diario o bitácora donde iré publicando los avances en las diferentes áreas de trabajo.

27/agosto/2013

UN concierto de Yemas para cerrar las jornadas de investigación en la Universidad Icesi. El afiche es diseñado por @miguel ceballos

9/agosto/2013

Un video de la jornada de patio sonoro en el Museo de Antioquia.

_

9/agosto/2013

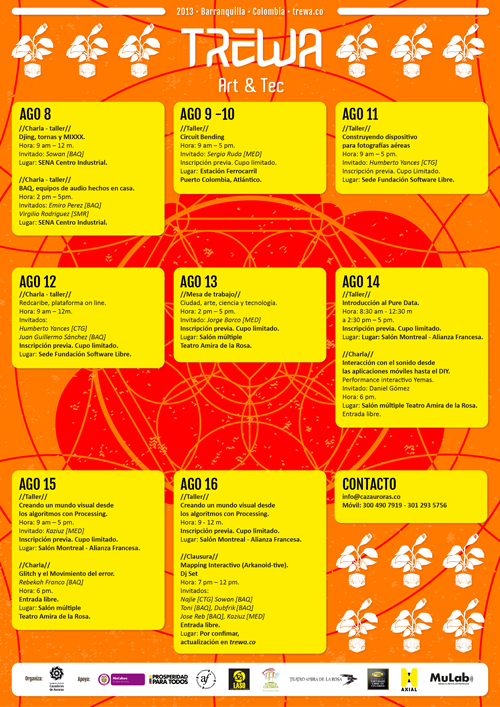

La semana entrante estaré en Barranquilla presentando Yemas y haciendo un taller de PD en el grán evento Trewa 2013

_

19/julio/2013

Ayer fue un día especial. El lanzamiento de el puerto donde me han invitdo a hacer un conversatorio y a hacer un concierto con Yemas. El concierto superó muis expectativas en cuanto a potencia del instrumento y en cuanto a la relevancia del ensamble con los grandes Jose Gallardo y Matías Uribe.

Este es el streaming del conversatorio:

_

16/julio/2013

Un video corto de Yemas. Gracias a Jose, Miguel, MariaClara, Mauricio y Daniela, Claudia.

_

15/julio/2013

Imágenes de Yemas en concierto. Diseño de imágenes interactivas por Miguel Ceballos. Dejando todo listo para el concierto de esta semana en el Puerto

_

10/julio/2013

Una invitación al concierto en el Museo de Antioquia en el marco del patio sonoro y como inauguración del Puerto

_

26/junio/2013

Día de mucho avance para Yemas. Trabajando muy fuerte con Jose Moncada logramos avanzar en el desarrollo de el multi touch para Yemas, de una manera muy pulida y muy fina. Salut!!!

_

14/junio/2013

El nacimiento de un mito: OSS

_

13/junio/2013

Con mucho pesar retiramos el paper de SMC que había obtenido muy buenos reviews del comité evaluador. Las nuevas políticas de Colciencias adoptadas a su vez por todas las Universidades Colombianas, hacen que eventos tan importantes como el Sound and Music Computing pasen fuera del radar para nuestro sistema. Nos quedamos alegres por el buen review que indica el buen trabajo realizado con Rafael Vega y Carlos Arce y por la nota de Roberto Bressin que decía "Your paper was scheduled for oral presentation in a section on Sonic Interaction Design. I hope that you can make it to SMC 2014."

_

10/mayo/2013

haciendo peer review de artículos para el SMC 2013

_

18/abril/2013

MUy bien el concierto telemático interpretando a John Cage. Pronto una grabación. Mientras un par de links a la prensa local que invita al evento: press1 press2

_

16/abril/2013

El hello world del morphasynth corre bien en Ipad. Tenemos una primera aplicación que suena en ipad, aunque aun sin interfaz. Salut!

_

10/abril/2013

Hoy he trabajado con @Jose Moncada movilizando el código de Yemas para correrlo en Ubuntu. Pensamos que sería una tarea compleja, pero con la magia de Jose (unas ediciones especiales al config) se logró que corriera sin ningun problema. Lo realmente interesante es que el performance de el OF en cuanto a framerate pasó de estar en 20-21 FPS a estar estable en 30FPS. Además logro correr PD a 5ms de latencia con Jack. Esto significa que he mejorado la latencia de Yemas casi en un 30%. Esto me ha dado una sensación de control y estabilidad en la interacción que antes no tenía. La latencia que tengo en este momento es aproximadamente (1000s/29fps = 34.48 OF) + (5ms PD) 40 ms… unpoquito mas que el umbral de percepción de simultaneidad. Sin embargo es un logro increible al tocar: ya se siente como un instrumento de verdad. De hoy en adelante solo Linux para trabajar con PD y OF. Además: weendoze es una pésima herramienta para trabajar en tiempo real en este setup OF+pd.

_

9/abril/2013

He sido invitado a interpretar une versión telemática de Four Six en el Festival Internacional de la Imagen. Estaré en Cali (Universidad ICESI) interpretando Yemas, Juan Reyes estará en Bogotá, Julián Jaramillo en Brasil (Universidad de Sao Pablo) y Mario Valencia en Manizales (Universidad de Caldas). Four Six es una obra de John Cage compsitor nacido en USA en 1912. El concierto será el miércoles 17 de abril a las 9pm hora Colombia.

_

15/marzo/2013

"Been a long time", una canción de "El Mami Patre 1" ha sido incluida en el compilado de música del 2012 de @diffuser.net. Diffueser.net es un sitio dedicado a la divulgación de música libre a través de la red.

_

12/marzo/2013

Un video interpretando Yemas pasando por alguno patches.

_

9/marzo/2013

Esta semana se construyó el primer prototipo de Yemas. El diseño viene de la clase de fabricación digital de Maria Clara Betancourt y el diseño es de Daniela Echeverry y Mauricio Issa. Esta semana también se retomó el trabajo del yemas multitouch con Jose Moncada y Felipe Salazar. Una imagen de el primer prototipo tomada por Claudia Solano.

_

4/marzo/2013

Interesante la relectura del libro de Jaques Attali 'Noise' Particularmente la sección final composing. Es un texto muy inspirador en donde la idea de composición, independiente de cualquier finalidad fuera de si misma, casi que como un ejercicio de placer, cobra mucho sentido: 'Una música producida por cada individuo para si mismo, por el placer fuera del significado, el uso o el intercambio'.

__

24/febrero/2012

Hoy moderando la presentación de Samuel Araujo y Juan Reyes en en II encuentro deantropología audio visual.

_

18/febrero/2012

Aunque en diciembre dejamos lista una gran parte del trabajo del Morphasynth. había que refinar algunos detalles. Algunos de estos detalles fueron analizar los sonidos con descriptores, organizar los sonidos con descriptores en el espacio y la mas compleja de todas: definir una manera de controlar el "aporte" de cada sonido a el cursor relacionado con su distancia. La intuición básica era hacer relaciones lineales y luego gausseanas demasiado básicas. Estas no funcionaban bien y generaban distorsiones en la configuración del sintetizador. Después de varios días aparece la solución mas elegante, pero poco intuitiva: 1 normalizar las distancias dividiendo por el total. 2 aplicar suavizado gaussiano. 3 encontrar el total de las distancias gausianas. 4 encontrar el inverso múltiplicativo (por que número multiplico para normalizar este vector) 5 multiplicar todas las distancias gauss por el inverso multiplicativo.

Ahora si con este método hay total suavidad al hacer transformaciones entre los sonidos. Próximamente unos samples.

__

19/diciembre/2012

Día para celebrar. El prototipo del morphasynth funciona técnicamente en PD. Un gran logro junto con @rafaelvega. Todas las hipótesis fueron correctas. Queda aun por hacer: las clasificaciones de los sonidos para lograr un espacio mas homogéneo sonoramente. Ponerlo a correr con la interfaz. Montarlo a la tableta. Pero por hoy… celebrar.

__

14/diciembre/2012

Perfecto set en la tora con @juanmaiz celebrando el cumpleaños y poniendo los mejores temas del 'disco austero'.

__

5/diciembre/2012

Prototipo monotouch de la lycra sensible testeado en popayán por usuario entusiasta. Gracias a @josemoncada por su ayuda en la programación del sensor óptico. por el momento se llama HiperYema. Que tal ese nombre? :P

__

12/noviembre/2012

Primera prueba del prototipo de instrumento 'superficie3' controlado con el ratón. Superficie3 es construido con PureData y GEM. El video fue editado por Davd Escobar de Reproducciones

http://re-producciones.blogspot.com/

__

6/noviembre/2012

Este fin de semana anterior fue intenso. Trabajando en el morphasynth en el extremo del usuario, mientras cavo el túnel para encontrarme con Rafa que viene desde el código. Fue muy interesante ver como las buenas ideas se van materializando y se confirma que el desarrollo si está muy bien fundamentado. Acá tres imágenes de una aproximación temprana a la interfaz. Mas adelante un video.

__

6/octubre/2012

Un increíble set ayer en LaTora haciendo Dj con laMezcladoraMartinez y FuCoff. Gracias a Sabriel Ganabria por la invitación. Disco austero!

__

5/octubre/2012

Mas avance en los parches de timbreID. Ya están los tutoriales explicativos de los descriptores de audio, de las maneras de hacer las listas generadas por múltiples descriptores en ventanas de análisis consecutivas; y finalmente, el uso del objeto para agrupar muestras con timbres similares. Después de una conversación con Rafa, hay una nueva idea de análisis para las muestras de audio de diferentes longitudes, separadas por porcentajes y no por distancias.

__

1/octubre/2012

He estado trabajando en unos patches de PD que sirvan de tutorial para el objeto timbreID de William Brent. Voy en 3 de 6, aca el link

__

3/septiembre/2012

Esta semana 'Disco Maris' será la canción de la semana en Radiónica. :) link

__

15/agosto/2012

Hoy hemos recibido una excelente noticia. Por primera vez hemos conseguido financiación estatal para el desarrollo de proyectos académicos relacionados con interacción. Lo hemos logrado en el marco de el proyecto Jóvenes Investigadores de Colciencias. Tendré entonces dos jóvenes investigadoras a mi cargo con tremendos proyectos: Estefanía Mejía y Claudia Ximena Solano. Este premio es muy interesante porque estas chicas recibirán 3 SMLV para desarrollar sus proyectos durante todo el año 2013. Perfecta manera de iniciarse en la investigación.

__

9/agosto/2012

Hoy ha sido el lanzamiento de el disco "El M.A.M.I. Parte 1". Casi que no. Este es el micorsitio donde se puede escuchar y descargar mami.seriesmedia.org

Aca el set de soundcloud para escucharlo:

__

18/julio/2012

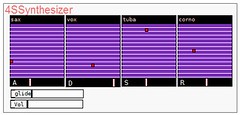

Hoy es un día importante. Hemos logrado compilar la primera versión del Morphasynth. Ya podremos trabajar en grupo en las actualizaciones y empezar a trabajar en los presets. Acá un pantallazo. Gracias a Rafa y LinaMarce por la paciencia.

__

17/julio/2012

Esta semana varias cosas: Rafa ha terminado la versión inicial del plugin de síntesis de audio, que él mismo ha nombrado 'morphasynth'. Lo interesante de este sintetizador (para nuestro proyecto) es que utiliza solamente sliders y ningún botón. Solo variables contínuas.Esto marca claramente la primera etapa del proyecto. Estamos entonces configurando varias máquinas para que funcionen bien con jack en Ubuntu. A veces es muy dificil, pero para eso está este tutorial.

__

15/julio/2012

Me he encontrado esta semana con el MUME 2012. Me pareció la oportunidad perfecta para escribir sobre el arduo trabajo realizado para momentum y para duvulgarlo a otro público. Aunque el artículo es un buen texto descriptivo del trabajo, la literatura científica general sobre temas de música generativa es vaga y no es muy conclusiva. Por lo que he encontrado, es un área mas del hacer que de la reflexión. Me parece interesante.

__

14/julio/2012

Un nuevo track que va a salir en el próximo disco de M.A.M.I. Que se llamará El mami (parte 1).

__

1/mayo/2012

Sobre la visita a Stanford y el Bay Area

la ciudad de san Francisco me impresionó mucho por la gente: La calidad de las personas lo querida que es la gente en la calle y en la Universidad. Tan amables como somos en Colombia aunque creemos que eso solo pasa aca . San francisco se hacaracterizado históricamente por tener un estilo de vida muy liberal, relacionado con los derechos civiles de los negros, de los gays y de los latinos. Hay por ejemplo unas leyes de protección a los vagabundos donde a los que se les da comida y no se les persigue. Por esto, hay muchísimos vagabundos o “Hobos” que caminan por las calles con toda la dignidad del mundo. Cuando venía en el avión, venía leyendo el libro “on the road” de Jack kerouack y precisamente el tema es del viaje de un escritor varias veces a través de estados unidos: siempre desde nueva york hasta san francisco viviendo como un hobo viajando en trenes y “echando dedo” etc… Cuando iba leyendo el libro no entendía cual era la gracia de ir a san Francisco y ya que llegué si lo entiendo. Es una zona con muchas libertades y con una informalidad y un clima que son especiales y difíciles de encontrar en Estados Unidos. Sobretodo en Nueva York.

Esa tolerancia e informalidad, creo que han hecho un ambiente muy propicio para la creatividad, una prueba de esto es que ahí mismo desde los 70s se haya creado la industria de los computadores y toda la tecnología digital (del mundo). Estando allá y viéndolo de cerca creo que es la consecuencia de una zona con pocas restricciones y mucha tolerancia, muy propicia para la experimentación, mezclada con el conocimiento tecnológico y el soporte de universidades como Stanford o Berkeley. Esa es mas o menos la historia un montón de hippies aficionados a los computadores con ideas nuevas y frescas buscan esa ciudad con de se siente cómodos y donde probablemente van a encontrar colegas con los que podrán trabajar.

Viendo todos los proyectos de Innovación de nuestras ciudades y universidades y conociendo el lugar de donde provienen esas propuestas. Me llega la pregunta de que si la innovación se puede forzar o apalancar. O mas bien es la consecuencia de elementos un entorno propicio para que esto funcione. También me pregunto si estas personas han pensado que la innovación no se da de 8 a 6 y los 5 días de la semana sino que tal vez es todo un estilo de vida lo que potencialice la innovación y la creatividad. Que hace un “innovador” a las 6pm? Se va para su casa? Si serán nuestras sociedades ultraconservadoras y miedosas capaces de generar un clima de innovación? Que estimula a un innovador a quedarse a vivir en nuestras ciudades?

Aca una foto con Rafa, Juan y John Chowning

__

13/abril/2012

Desde ayer en el LAC en la Universidad de Stanford con Rafael Vega.

Hoy se centra la discusión en speech recognition usando Linux y luego en Ambisonics. Nuestra ponencia es el domingo y el tema es el uso de la Beagleboard para procesar audio usando PD.

__

6/marzo/2012

Un track que será publicado en el próximo disco de M.A.M.I.

__

25/febrero/2012

Via dspstv conocí el PdDroidParty creado por Chris McCormick. Con esta aplicación para sistema operativo Android se pueden correr parches de PD en el dispositivo. Hoy estoy corriendo los parches de demostración que ha creado Chris, la idea es desarrollar varias aplicaciones para ser usadas en situaciones de interpretación en vivo y medir hasta que punto de procesamiento puedo llegar con el dispositivo que tengo. Aquí un documento con los avances.

__

20/febrero/2012

A través de kardioid ha llegado el link de Juan Gonzalo quien ha traducido el libro de Miller Puckette de teoría y técnica de música electrónica.

__

16/febrero/2012

Hoy a través del canal de labSurlab del IRC dspstv me ha pasado este link de un parche de hace 8 años en un estudio que compartía en esos días con Popmachine. Un taller de PD y max/msp. Wow!

__

24/enero/2012

Uno de los proyectos interesantes en los que participé el año pasado, realizado entre los grupos Acorde (del MIT de Medellín) y Leonardo de la Icesi en Cali Junto con el saxofonista Oscar Plaza de la Universidad del Valle, llegó a una primera fase de culminación: Se adaptó un sensor de movimiento a un saxofón, con los datos se elaboró un sistema de mapping de varios gestos a diferentes variables contínuas y discretas de un procesador de audio en PD. El procesador de audio tiene síntesis granular, modulación de anillo, reverberaciones, delays y armonizadores. Se montó una pieza de Jose Gallardo (aka Música Inmobiliaria) con el saxofonista donde se ajustaron los algoritmos de reconocimiento de gestos a la gestualidad de Oscar. El trabajo fue realizado por el estudiante John Melo y tuve la fortuna de ser el tutor. Aquí el resultado:

__

14/enero/2012

Re producciones (aka Lina y David) nos han entregado los fantásticos documentos del comunlab realizado en octubre en Cali. Aca está el promo pero en la página de comunlab y de reproducciones se encuentran las entrevistas a la mayoría de los personajes que participaron.

__

8/noviembre/2010

El jueves 24 de octubre en la mañana, terminé por azar del destino en un comisión de la AES dedicada a Factores Humanos. Ayer me he encontrado con la invitación de la AES para participar en la comisión técnica de human factors in audio systems.

__

30/octubre/2011

Este ha sido el mes mas agitado del año: la preparación y finalmente la presentación en la AES y la semana siguiente el ejercicio de asociación y discusión del comunlab. En NY tuve la oportunidad de hacer un muy buen intercambio de ideas y conocimiento con varios personajes involucrados con el tema de síntesis y procesamiento de audio, como un subconjunto dentro de la Asociación de Ingeniería de Sonido. Nuevos horizontes y afirmación de que nuestra visión sobre las herramientas de síntesis de audio está clara y con vida.

Por otro lado, el comunlab fue la oportunidad perfecta para conocer a los actores Caleños que se mueven en torno a las expresiones libres y el DIY no solo en la tecnología sino (sobretodo) en la comunicación. Al mismo tiempo, diversos parches de Colombia nos acompañaron con la mejor disposición de compartir sus conocimiento pero sobretodo de articularse y de generar un tejido que, aunque temporal, estimula el deseo de seguir trabajando en cada uno de los temas. Para destacar varias cosas pero principalmente el trabajo de Rafa Vega, la buena energía en escena y música de los chicos de RadioNoise + Checho y el aporte a una visión mas humana (y tal vez mas efectiva) de todo el asunto de los hacklabs o hackspaces de unloquer. Nuevos parceros en la escena como Fellini en Manizales y Ojo al Sancocho en Bogotá.

Acá un poco del esparcimiento del comunlab:

__

9/septiembre/2011

Hoy hemos terminado el ensamble en PD del proyecto 'vstGUIgen'. Tenemos varios grupos de presets y realizamos a cada grupo un análisis paramétrico de frecuecnias por rangos. Este análisis ofrece una visión de rangos mas usados en tipos de sonidos. Es una especie de corte 'paso alto' a la imagen publicada el 13 de enero de este año (ver mas abajo). Una interfaz adicional con mejor aspecto hecha en OpenFrameworks está siendo desarrollada por Juan Carlos Pérez. El ha utilizado varios add ons que han resultado bastante útiles para su implementación. Mas adelante tendremos mas detalles de las herramientas que utilizó y tendremos un video de la interfaz en funcionamiento.

Aca una imagen de la interfaz:

__

8/agosto/2011

La canción MCaAPV de M.A.M.I. Ha sido seleccionada como la canción de la semana en radiónica. Una grata sorpresa para empezar la semana. Este track fue compuesto entre octubre y noviembre de 2010 y fue publicado en el disco compilado Series Vol. 2 en el sello SeriesMedia.

26/julio/2011

Diseñé el sonido de el desfile de Amulette en Colombiamoda 2011

__

8/julio/2011

En estos últimos dos meses hemos avanzado en varias direcciones: Estamos trabajando con Jose Moncada y Jaime Cruz en el desarrollo de una aplicación de tracking de manos basado en OpenFrameworks y Kinect. La aplicación al día de hoy está en un 70% de desarrollo. La geometría y las condiciones para efectuar una medición correcta e independiente de cada dedo están ya claras probadas y funcionan. El 30% que resta es de afinar la programación y estabilizar las mediciones.

He recibido aceptación de una ponencia para la AES 2011 en la ciudad de Nueva York en el tema de disminución de variables para sintetizadores. La ponencia será en octubre de este año.

Paralelo a esto he tenido avances en el proyecto de síntesis FM y el proyecto del Timbre Space.

El 1 y 2 de julio estuve en el Campus Party realizando un taller de síntesis de audio (link) y un conversatorio sobre publicaciones muscales en red. Aca un par de fotos del evento:

__

19/abril/2011

Para utilizar el objeto [timbreID] es necesario apoyarse en dos tablas esenciales: una tabla de audio (cargada desde un .wav) donde están grabadas todas las muestras en un orden secuencial; y otra tabla de números, donde se hacen explícitos los valores de inicio de ataque de cada una de las muestras. Para realizar el análisis de los sonidos de un instrumento es necesario crear el archivo de todos los sonidos juntos y paralelo a esto grabar los tiempos de inicio de ataque en un archivo .txt aparte.

__

15/abril/2011

He estado revisando opciones de herramientas para usar los descriptores de audio de MPEG7 en entornos mas sencillos como PD. He descubierto la librería timbreID de William Brent que describo en la sección de software: usa 13 descriptores de audio para elaborar clasificaciones de sonidos. Hasta ahora he revisado un objeto que lee todos los sonidos de una carpeta y genera una gran matriz de clasificación a un archivo. Una vez creado este archivo (puede crearse mas rápido que leyendo los samples en tiempo real) es posible usarlo para realizar clustering y ordenamiento de sonidos según las 13 características implementadas por Brent, incluyendo la posibilidad de ponderar la importancia de ellas en el resultado final. El resultado obtenido son grupos de sonidos "similares" según los criterios de clasificación utilizados.

Estos objetos serán útiles por ejemplo, para agrupar los sonidos extraídos de un solo instrumento como un violín (ver ejemplo). O para agrupar sonidos que tengan características similares entre si, que hayan sido extraídos de librerías muy extensas y dispares.

__

25/marzo/2011

He estado muy productivo trabajando en varios algoritmos interesantes que hemos presentado en el evento LASACAS de la I triple E en Bogotá. Estoy involucrados en algo que podría llamarse "customización de sintetizadores VST" He obtenido ayuda y colaboración de el profesor Joern Loviscach y de Julián Villegas en la conceptualización del proyecto y en la revisión de un texto y en compartir bibliografía. El tema se ha adentrado hacia la clasificación de sonidos basados en el timbre. Para esto hemos estudiado los descriptores de sonido del estandar MPEG7 y su uso para clasificar presets de sintes. Esto es para preparar el material para nuestros experimentos. Para preparar este material he tenido que estudiar lo el uso de diferentes técnicas de reducción de dimensiones y he contado con la ayuda y entusiasmo de Juan Sebastián Botero quien ha aplicado el MIRtoolbox para extraer 13 descriptores de las muestras de audio de los presets y realizará PCA para encontrar grupos de muestras en un plano bidimensional.

Paralelo a esto he estado estudiando la resíntesis de sonidos usando la magnitud y la fase. He preparado una tableta wacom como instrumento gestual para manipular estas síntesis. Próximamente estaremos haciendo experimentos con PD y este patch de resíntesis. Me ha inspirado mucho un artículo del SMC del año pasado llamado Creation and exploration of a perceptual sonic textures space using a tangible interface. Me parece que conceptualmente es mucho mas potente que el reactable.

__

13/enero/2011

Esta es la imagen topográfica de una versión digital del Roland Juno con todas sus variables y sus presets.

La pregunta interesante es: ¿que pasaría si pudiésemos escoger la altura sobre la cota cero a la cual queremos tocar el sintetizador?

Esta es una de las líneas de trabajo que nos ocupan en este momento en Maistudio. Estamos preparando un paper para el NIME 2011 en este tema.

__

6/enero/2010

Esta arriba el audio de la charla en subterrakeo sobre síntesis de audio. Cortesía de jardincósmico

__

20/diciembre/2010

Esta es la segunda semana de estudio de Chuck y hemos podido avanzar lentamente en su programación. En esta página postearé todos los patches exitosos comentados para que sirvan de material de estudio.

__

16/diciembre/2010

Dentro de 10 días. El 26 de diciembre lunes estaremos en Subterrakeo realizando un taller/conversatorio de síntesis de audio. Si estás en Medellín y te interesa la música / el sonido / las máquinas que se usan para hacerlo / la experimentación / los parches libres, este es el evento: (aca en facebook)

__

3/diciembre/2010

Ya están en línea los videos de Momentum. Obra de Venuz White y música de Daniel Gómez. Todos los videos aqui

__

1/octubre/2010

Se inauguró la exposición "Momentum: origen de un instante en el tiempo" en donde trabajamos con la artista Venuz White en la ambientación sonora de unos videos increibles.

El próximo martes 5 de octubre estaré haciendo un concierto en Cali en el evento Equinoccio. Voy a interpretar tres de las piezas de los planetas realizadas para la exposición Momentum. Acá mas info: http://www.icesi.edu.co/equinoccio/

__

15/septiembre/2010

Un nuevo proyecto que involucra la vía láctea. Esta es una toma de un patch con características automáticas que responden a la rotación de los planetas. El proyecto está en crear siete "espacios sonoros" usando la rotación de los astros como material base.

__

10/julio/2010

Una nueva actualización de el track. Usando el Morph Synthesizer y el 4Stage Synthesizer, con un poco de Timbre Stamp.

__

4/julio/2010

Usando el MorphSynthesizer y un patch que hace enlaces de acordes armónicos sale este track. El sonido del sintetizador no deja de sorprenderme.

__

18/junio/2010

Nuevo sintetizador 4SS actualizado en PD Tools.

Este sinte esta en desarrollo y promete ser una buena evolución del IM2 (Instrument Morpher 2).

__

15/junio/2010

Actualmente está en actividad el desarrollo de herramientas llamado PD Tools. Se ha subido el PDF del nuevo Instrumento "Instrument Morpher 2"

El 29 de este mes estaré junto con Federico López realizando una charla en el encuentro iberoamericano de cultuta en la programación de zona de riesgo. Como verán el evento parece interesante. El panel está titulado asi:

PANEL 2 ::: Software libre y música, posibilidades de creación e investigación con nuevas tecnologías y software libre.

4:pm en la Casa del Encuentro del Museo de Antioquia

__

10/junio/2010

Maistudio llega a un acuerdo con el compositor José Gallardo para el uso de las PD Tools y los módulos de síntesis en sus clases de composición electroacústica en la Universidad EAFIT.

__

13/abril/2010

Armado con un grupo de herramientas de PD Tools voy a la ciudad de Manizales a realizar un concierto en el Festrival Internacional de la Imagen. También realizo una ponencia sobre el diseño de interfaces para síntesis de audio digital.

__